Όταν η Τεχνητή Νοημοσύνη υπονομεύει τη δημόσια πολιτική

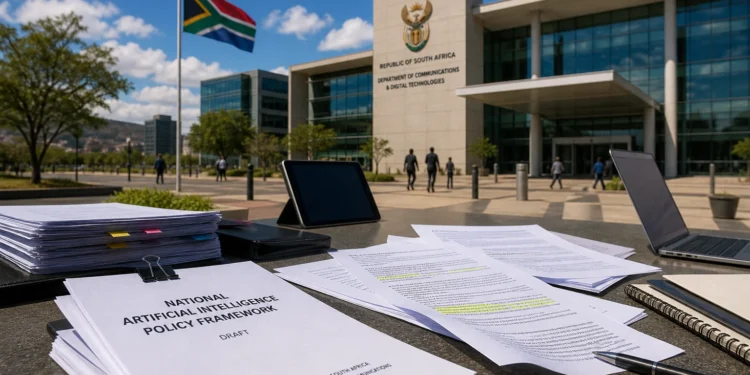

Η Νότια Αφρική βρέθηκε στο επίκεντρο μιας ιδιαίτερα αποκαλυπτικής υπόθεσης για τη χρήση της Τεχνητής Νοημοσύνης στον δημόσιο τομέα. Η κυβέρνηση αναγκάστηκε να αποσύρει το προσχέδιο της εθνικής πολιτικής για την AI, όταν αποκαλύφθηκε ότι περιείχε ψευδείς ακαδημαϊκές αναφορές, οι οποίες είχαν παραχθεί από εργαλεία γενετικής τεχνητής νοημοσύνης.

Η εξέλιξη αυτή δεν αποτελεί απλώς ένα μεμονωμένο περιστατικό, αλλά αναδεικνύει ένα ευρύτερο και αυξανόμενο πρόβλημα, την ανεξέλεγκτη χρήση AI σε κρίσιμα έγγραφα υψηλής σημασίας, χωρίς την απαραίτητη ανθρώπινη επιβεβαίωση.

Τι συνέβη με την πολιτική AI της Νότιας Αφρικής

Το προσχέδιο πολιτικής είχε σχεδιαστεί με στόχο να τοποθετήσει τη Νότια Αφρική στην πρώτη γραμμή της καινοτομίας στον τομέα της τεχνητής νοημοσύνης. Περιλάμβανε στρατηγικές για ανάπτυξη υποδομών, ενίσχυση συνεργασιών με τον ιδιωτικό τομέα και δημιουργία θεσμικών οργάνων εποπτείας.

Ωστόσο, η αξιοπιστία του εγγράφου αμφισβητήθηκε όταν εντοπίστηκε ότι τουλάχιστον 6 από τις 67 ακαδημαϊκές αναφορές δεν υπήρχαν στην πραγματικότητα. Αν και τα επιστημονικά περιοδικά που αναφέρονταν ήταν υπαρκτά, τα συγκεκριμένα άρθρα ήταν κατασκευασμένα.

Η αποκάλυψη οδήγησε στην άμεση απόσυρση του εγγράφου από τον υπουργό Επικοινωνιών της χώρας, ο οποίος αναγνώρισε ότι πρόκειται για σοβαρή αποτυχία που πλήττει την αξιοπιστία της πολιτικής.

Οι «παραισθήσεις» της AI και το πρόβλημα των ψεύτικων πηγών

Το φαινόμενο που παρατηρήθηκε ονομάζεται “AI hallucination”. Πρόκειται για περιπτώσεις όπου τα μοντέλα τεχνητής νοημοσύνης δημιουργούν πληροφορίες που φαίνονται αξιόπιστες, αλλά στην πραγματικότητα δεν είναι αληθινές.

Τα σύγχρονα γλωσσικά μοντέλα δεν λειτουργούν ως μηχανές επαλήθευσης της αλήθειας. Αντίθετα, βασίζονται σε στατιστικά μοτίβα και προβλέπουν ποια λέξη ή φράση είναι πιθανότερο να ακολουθήσει. Όταν δεν διαθέτουν επαρκή δεδομένα, συχνά «γεμίζουν τα κενά» με πειστικά αλλά λανθασμένα στοιχεία.

Στην περίπτωση της Νότιας Αφρικής, αυτό μεταφράστηκε σε κατασκευασμένες βιβλιογραφικές αναφορές, οι οποίες πέρασαν απαρατήρητες μέχρι τον έλεγχο από δημοσιογράφους και εκδότες επιστημονικών περιοδικών.

Η αυξανόμενη διάδοση του προβλήματος στην ακαδημαϊκή κοινότητα

Το περιστατικό αυτό δεν είναι μεμονωμένο. Τα τελευταία χρόνια, παρατηρείται αυξανόμενη χρήση εργαλείων AI στην παραγωγή επιστημονικών και διοικητικών κειμένων.

Σύμφωνα με πρόσφατες μελέτες, ένα σημαντικό ποσοστό επιστημονικών δημοσιεύσεων περιέχει τουλάχιστον μία πιθανώς ψευδή ή «hallucinated» αναφορά. Το ποσοστό αυτό αυξάνεται ραγδαία, γεγονός που δημιουργεί σοβαρές ανησυχίες για την αξιοπιστία της επιστημονικής γνώσης.

Η χρήση AI χωρίς επαρκείς ελέγχους μπορεί να οδηγήσει σε αλυσιδωτά προβλήματα, από λανθασμένες έρευνες μέχρι εσφαλμένες πολιτικές αποφάσεις.

Οι επιπτώσεις για τη δημόσια διοίκηση και την πολιτική

Η υπόθεση της Νότιας Αφρικής αναδεικνύει έναν κρίσιμο κίνδυνο, τη χρήση AI σε κυβερνητικά έγγραφα χωρίς μηχανισμούς ελέγχου ποιότητας.

Όταν μια εθνική πολιτική βασίζεται σε μη υπαρκτές πηγές, υπονομεύεται όχι μόνο η εγκυρότητα του περιεχομένου, αλλά και η εμπιστοσύνη των πολιτών στους θεσμούς.

Η ανάγκη για διαφάνεια, αξιοπιστία και τεκμηρίωση γίνεται ακόμη πιο επιτακτική σε μια εποχή όπου η AI ενσωματώνεται όλο και περισσότερο στις διαδικασίες λήψης αποφάσεων.

Θεσμικά μέτρα που προτάθηκαν στο προσχέδιο

Παρά το πρόβλημα, το αρχικό προσχέδιο περιλάμβανε σημαντικές πρωτοβουλίες που δείχνουν τη στρατηγική κατεύθυνση της χώρας:

- Δημιουργία εθνικής επιτροπής για την τεχνητή νοημοσύνη

- Σύσταση συμβουλίου ηθικής AI

- Ίδρυση ρυθμιστικής αρχής για την εποπτεία εφαρμογών AI

- Παροχή φορολογικών κινήτρων και επιδοτήσεων για ανάπτυξη υποδομών

- Ενίσχυση συνεργασιών μεταξύ δημόσιου και ιδιωτικού τομέα

Τα μέτρα αυτά παραμένουν επίκαιρα και αναμένεται να επανεξεταστούν στο νέο, διορθωμένο προσχέδιο.

Το κρίσιμο μάθημα: Η ανθρώπινη επίβλεψη είναι απαραίτητη

Η υπόθεση καταδεικνύει με σαφήνεια ότι η Τεχνητή Νοημοσύνη δεν μπορεί να λειτουργήσει αυτόνομα σε κρίσιμα περιβάλλοντα χωρίς ανθρώπινη παρέμβαση.

Η χρήση AI ως εργαλείο υποστήριξης μπορεί να προσφέρει σημαντικά οφέλη, αλλά η πλήρης εμπιστοσύνη χωρίς έλεγχο ενέχει σοβαρούς κινδύνους.

Οι οργανισμοί, είτε πρόκειται για κυβερνήσεις είτε για εταιρείες, πρέπει να υιοθετήσουν διαδικασίες όπως:

- Υποχρεωτικός έλεγχος όλων των παραπομπών

- Διασταύρωση πληροφοριών από αξιόπιστες πηγές

- Εκπαίδευση προσωπικού στη σωστή χρήση AI

- Εφαρμογή πολιτικών υπεύθυνης χρήσης τεχνητής νοημοσύνης

Το μέλλον της AI στη διαμόρφωση πολιτικής

Παρά τα προβλήματα, η Τεχνητή Νοημοσύνη παραμένει ένα ισχυρό εργαλείο για τη διαμόρφωση πολιτικής. Η δυνατότητα ανάλυσης μεγάλων όγκων δεδομένων, πρόβλεψης τάσεων και αυτοματοποίησης διαδικασιών μπορεί να βελτιώσει σημαντικά τη λειτουργία των κρατών.

Ωστόσο, η αξιοποίηση αυτών των δυνατοτήτων απαιτεί ένα ισχυρό πλαίσιο διακυβέρνησης, που θα διασφαλίζει την ακρίβεια, τη διαφάνεια και την υπευθυνότητα.

Η Νότια Αφρική αναμένεται να επανεκδώσει την πολιτική της μετά από αναθεώρηση, ενσωματώνοντας τα απαραίτητα μέτρα για την αποφυγή παρόμοιων λαθών.

Συμπέρασμα

Η απόσυρση της πολιτικής AI στη Νότια Αφρική αποτελεί ένα ηχηρό παράδειγμα των κινδύνων που συνοδεύουν την ανεξέλεγκτη χρήση της τεχνητής νοημοσύνης.

Το περιστατικό αυτό υπογραμμίζει ότι η AI δεν είναι αλάνθαστη και ότι η ανθρώπινη κρίση παραμένει αναντικατάστατη, ιδιαίτερα όταν πρόκειται για αποφάσεις που επηρεάζουν ολόκληρες κοινωνίες.

Η ισορροπία μεταξύ καινοτομίας και υπευθυνότητας θα αποτελέσει τον καθοριστικό παράγοντα για το πώς η AI θα ενσωματωθεί αποτελεσματικά στο μέλλον της δημόσιας διοίκησης.