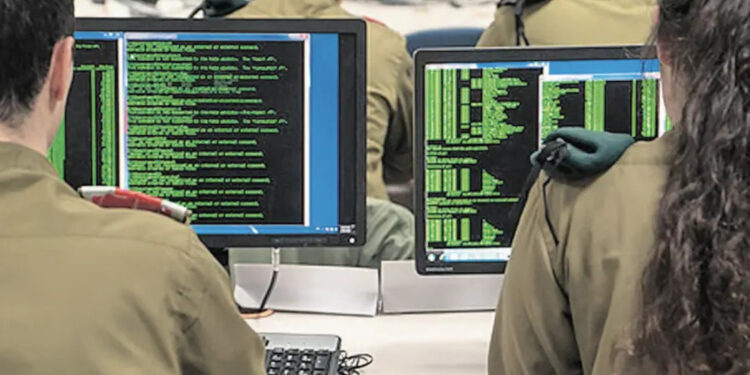

Η Ισραηλινή Στρατιωτική Τεχνολογία Τεχνητής Νοημοσύνης και οι Ηθικές Προκλήσεις της

Η ισραηλινή στρατιωτική υπηρεσία έχει αναπτύξει ένα εργαλείο τεχνητής νοημοσύνης (AI) χρησιμοποιώντας μεγάλες ποσότητες παλαιστινιακών επικοινωνιών που έχουν υποκλαπεί, όπως αποκάλυψε κοινή έρευνα από The Guardian, +972 Magazine και Local Call. Αυτό το εργαλείο, που αναπτύχθηκε από τη Μονάδα 8200, μέρος της ισραηλινής υπηρεσίας πληροφοριών, έχει σχεδιαστεί για να αναλύει υποκλαπείσες συνομιλίες και μηνύματα κειμένου, προκαλώντας ανησυχίες για την επιτήρηση και την ηθική χρήση της τεχνητής νοημοσύνης στις επιχειρήσεις πληροφοριών. Η τεχνολογία αυτή αναπτύχθηκε για να κατανοήσει την ομιλούμενη αραβική γλώσσα μέσω εκτεταμένων δεδομένων επιτήρησης που συλλέγονται από τα κατεχόμενα παλαιστινιακά εδάφη. Το σύστημα, που περιγράφεται ως ένα σύστημα τύπου chatbot, επιτρέπει στους αξιωματικούς πληροφοριών να αναζητούν μεγάλες ποσότητες δεδομένων για άμεσες πληροφορίες σχετικά με άτομα υπό επιτήρηση. Η ανάπτυξη του μοντέλου τεχνητής νοημοσύνης επιταχύνθηκε μετά το ξέσπασμα του πολέμου στη Γάζα τον Οκτώβριο του 2023, αν και παραμένει ασαφές αν το σύστημα έχει πλήρως αναπτυχθεί.

Η Μεγάλης Κλίμακας Προσπάθεια Πληροφοριών της Μονάδας 8200

Η Μονάδα 8200, που συχνά συγκρίνεται με την Εθνική Υπηρεσία Ασφαλείας των ΗΠΑ (NSA), έχει μακρά ιστορία χρήσης εργαλείων με τεχνητή νοημοσύνη για τη συλλογή πληροφοριών. Τα συστήματα τεχνητής νοημοσύνης, όπως το Gospel και το Lavender, έπαιξαν καθοριστικό ρόλο στον εντοπισμό στόχων για αεροπορικές επιδρομές στη Γάζα, διευκολύνοντας τον ταχύ βομβαρδισμό χιλιάδων τοποθεσιών από τον ισραηλινό στρατό. Κατά τη διάρκεια ενός στρατιωτικού συνεδρίου τεχνητής νοημοσύνης στο Τελ Αβίβ πέρυσι, ο πρώην τεχνολόγος στρατιωτικών πληροφοριών Chaked Roger Joseph Sayedoff αναγνώρισε ότι το έργο απαιτούσε “ψυχωτικές ποσότητες” δεδομένων, ισχυριζόμενος ότι ο στόχος ήταν η δημιουργία της μεγαλύτερης δυνατής βάσης δεδομένων από αραβόφωνες επικοινωνίες. Πρώην αξιωματούχοι πληροφοριών επιβεβαίωσαν την ύπαρξη της πρωτοβουλίας και περιέγραψαν πώς χρησιμοποιήθηκαν πρώιμα μοντέλα μηχανικής μάθησης πριν από την έναρξη του πιο προηγμένου συστήματος.

Ηθικά και Νομικά Ζητήματα της Χρήσης Τεχνητής Νοημοσύνης

Οι υπερασπιστές των ανθρωπίνων δικαιωμάτων έχουν προειδοποιήσει ότι η ενσωμάτωση της τεχνητής νοημοσύνης στις στρατιωτικές πληροφορίες ενέχει σημαντικούς κινδύνους, όπως η προκατάληψη, τα λάθη και η έλλειψη διαφάνειας. Ο Zach Campbell, ανώτερος ερευνητής επιτήρησης στο Human Rights Watch (HRW), επέκρινε τη δυνητική χρήση μεγάλων γλωσσικών μοντέλων (LLMs) για τη λήψη αποφάσεων σχετικά με τους Παλαιστίνιους υπό ισραηλινή κατοχή. Ο Nadim Nashif, διευθυντής της παλαιστινιακής οργάνωσης ψηφιακών δικαιωμάτων 7amleh, υποστήριξε ότι οι Παλαιστίνιοι έχουν ουσιαστικά μετατραπεί σε “υποκείμενα στο εργαστήριο του Ισραήλ” για την ανάπτυξη τεχνητής νοημοσύνης, ισχυριζόμενος ότι τέτοιες τεχνολογίες ενισχύουν τους μηχανισμούς επιτήρησης και ελέγχου.

Η Χρήση Τεχνητής Νοημοσύνης σε Στρατιωτικές Επιχειρήσεις

Οι αναφορές υποδεικνύουν ότι η τεχνητή νοημοσύνη έχει παίξει κεντρικό ρόλο στις ισραηλινές στρατιωτικές επιχειρήσεις, ιδιαίτερα στη Γάζα. Σύμφωνα με πηγές που αναφέρθηκαν από την Washington Post, τα εργαλεία τεχνητής νοημοσύνης επέτρεψαν στον ισραηλινό στρατό να επεξεργαστεί γρήγορα τις πληροφορίες και να εκτελέσει χιλιάδες αεροπορικές επιδρομές μέσα σε λίγες εβδομάδες. Τα μοντέλα τεχνητής νοημοσύνης όπως το Lavender και το Gospel χρησιμοποιήθηκαν για την ανάλυση υποκλαπείσων επικοινωνιών και τον εντοπισμό πιθανών στόχων. Ωστόσο, πρώην στρατιωτικοί αξιωματούχοι έχουν εκφράσει ανησυχίες για την εξάρτηση από την τεχνητή νοημοσύνη στον πόλεμο, ισχυριζόμενοι ότι η ταχύτητα και η αυτοματοποίηση της επιλογής στόχων μείωσαν τον χρόνο για ανθρώπινη εποπτεία, οδηγώντας σε λάθη.

Συμπεράσματα για το Μέλλον της Τεχνητής Νοημοσύνης στην Επιτήρηση και τον Πόλεμο

Η χρήση της τεχνητής νοημοσύνης στις στρατιωτικές πληροφορίες αναμένεται να επεκταθεί, προκαλώντας ανησυχίες για την ιδιωτικότητα, την υπευθυνότητα και την ασφάλεια των πολιτών. Ενώ η τεχνητή νοημοσύνη μπορεί να ενισχύσει τις ικανότητες πληροφοριών, οι ειδικοί προειδοποιούν ότι η τεχνολογία παραμένει επιρρεπής σε προκαταλήψεις και λάθη που μπορεί να έχουν σοβαρές συνέπειες στην πραγματική ζωή. Η Brianna Rosen, πρώην αξιωματούχος εθνικής ασφάλειας του Λευκού Οίκου, προειδοποίησε ότι η προβλεπτική φύση της τεχνητής νοημοσύνης καθιστά δύσκολη την επαλήθευση της ακρίβειάς της.