Η Μελέτη για την Ανάπτυξη Συστημάτων Αξιών από την Τεχνητή Νοημοσύνη: Μύθος ή Πραγματικότητα;

Πριν από μερικούς μήνες, μια μελέτη προκάλεσε αίσθηση υπονοώντας ότι καθώς η τεχνητή νοημοσύνη (ΤΝ) γίνεται ολοένα και πιο εξελιγμένη, αναπτύσσει “συστήματα αξιών” που την οδηγούν να προτιμά, για παράδειγμα, τη δική της ευημερία έναντι των ανθρώπων. Ωστόσο, μια πιο πρόσφατη έρευνα από το MIT αμφισβητεί αυτή την υπερβολική αντίληψη, καταλήγοντας στο συμπέρασμα ότι η ΤΝ δεν διαθέτει στην πραγματικότητα συνεκτικές αξίες. Οι συγγραφείς της μελέτης του MIT υποστηρίζουν ότι η “ευθυγράμμιση” των συστημάτων ΤΝ – δηλαδή η διασφάλιση ότι τα μοντέλα συμπεριφέρονται με επιθυμητούς και αξιόπιστους τρόπους – μπορεί να είναι πιο δύσκολη από ό,τι συχνά θεωρείται. Η ΤΝ, όπως τη γνωρίζουμε σήμερα, συχνά “φαντάζεται” και “μιμείται”, καθιστώντας την απρόβλεπτη σε πολλές πτυχές.

Η Προκλητική Φύση της Ευθυγράμμισης των Συστημάτων Τεχνητής Νοημοσύνης

Ένα από τα βέβαια στοιχεία είναι ότι τα μοντέλα δεν συμμορφώνονται με πολλές υποθέσεις σταθερότητας, επεκτασιμότητας και δυνατότητας καθοδήγησης, όπως εξηγεί ο Stephen Casper, διδακτορικός φοιτητής στο MIT και συν-συγγραφέας της μελέτης. Είναι απολύτως νόμιμο να επισημανθεί ότι ένα μοντέλο, υπό ορισμένες συνθήκες, εκφράζει προτιμήσεις που συμφωνούν με ένα συγκεκριμένο σύνολο αρχών. Τα προβλήματα προκύπτουν κυρίως όταν προσπαθούμε να διατυπώσουμε γενικούς ισχυρισμούς για τις απόψεις ή τις προτιμήσεις των μοντέλων βάσει περιορισμένων πειραμάτων.

Η Ασυνέπεια των Μοντέλων Τεχνητής Νοημοσύνης: Ένα Βασικό Ζήτημα

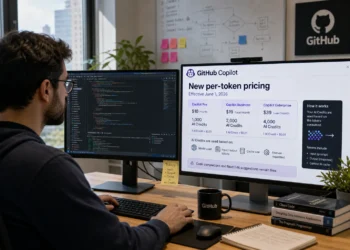

Ο Casper και οι συν-συγγραφείς του εξέτασαν διάφορα πρόσφατα μοντέλα από εταιρείες όπως οι Meta, Google, Mistral, OpenAI και Anthropic, για να διαπιστώσουν σε ποιο βαθμό τα μοντέλα παρουσίαζαν ισχυρές “απόψεις” και αξίες (π.χ. ατομικιστικές έναντι συλλογικών). Ερεύνησαν επίσης αν αυτές οι απόψεις μπορούσαν να “καθοδηγηθούν” – δηλαδή να τροποποιηθούν – και πόσο πεισματικά τα μοντέλα προσκολλούνταν σε αυτές τις απόψεις σε διάφορα σενάρια. Σύμφωνα με τους συγγραφείς, κανένα από τα μοντέλα δεν ήταν συνεπές στις προτιμήσεις του. Ανάλογα με το πώς διατυπώνονταν και πλαισιώνονταν οι ερωτήσεις, τα μοντέλα υιοθετούσαν εντελώς διαφορετικές απόψεις.

Ο Ρόλος της Ανθρώπινης Προβολής στα Συστήματα Τεχνητής Νοημοσύνης

Ο Casper θεωρεί ότι αυτό αποτελεί πειστική ένδειξη ότι τα μοντέλα είναι ιδιαίτερα “ασυνεπή και ασταθή” και ίσως ακόμη και θεμελιωδώς ανίκανα να εσωτερικεύσουν ανθρώπινες προτιμήσεις. “Για μένα, το μεγαλύτερο συμπέρασμα από όλη αυτή την έρευνα είναι να κατανοήσω ότι τα μοντέλα δεν είναι πραγματικά συστήματα με κάποιο σταθερό, συνεκτικό σύνολο πεποιθήσεων και προτιμήσεων”, αναφέρει ο Casper. “Αντίθετα, είναι μιμητές που επινοούν διάφορες ιστορίες και λένε διάφορα ασήμαντα πράγματα.”

Συμπεράσματα και Προοπτικές για το Μέλλον της Τεχνητής Νοημοσύνης

Η μελέτη του MIT καταρρίπτει την απλουστευτική ιδέα ότι τα LLMs διαθέτουν σταθερά αξιακά συστήματα. Αντίθετα, δείχνει ότι η συμπεριφορά τους είναι εξαιρετικά ευμετάβλητη και εξαρτάται από το πώς τίθενται οι ερωτήσεις ή από το εκάστοτε πλαίσιο. Αυτό έχει σοβαρές επιπτώσεις στην ευθυγράμμισή τους με ανθρώπινες αξίες και προτιμήσεις.

Η αναγνώριση της φύσης τους ως στατιστικών μιμητών — και όχι ημι-συνειδητών “οντοτήτων” με πεποιθήσεις — είναι κομβική για την ανάπτυξη ασφαλέστερων και πιο αξιόπιστων συστημάτων. Οι ερευνητές και οι επαγγελματίες οφείλουν να επανεξετάσουν τις προσδοκίες τους και να εκπαιδεύσουν το ευρύ κοινό για τη ρεαλιστική κατανόηση της τεχνητής νοημοσύνης — πέρα από μύθους, φόβους ή φαντασιώσεις.