Πώς τα “Cartridges” και η τεχνική self-study συμπιέζουν το context, ρίχνουν μνήμη/κόστος έως και τάξεις μεγέθους και ανοίγουν τον δρόμο για πραγματικά προσωποποιημένους πράκτορες ΤΝ

Η ικανότητα μιας Τεχνητής Νοημοσύνης (ΤΝ) να «καταλαβαίνει» το πλαίσιο (context) του χρήστη —π.χ. ολόκληρα νομικά έγγραφα, μεγάλα codebases, ιατρικούς φακέλους ή προσωπικά αρχεία— χτίστηκε ως τώρα πάνω σε μία ακριβή υπόθεση: «βάλ’ τα όλα στο prompt». Όμως όσο μεγαλώνει το context, αυξάνονται εκθετικά η μνήμη, ο χρόνος και το ενεργειακό κόστος για να παραχθεί μία απάντηση. Μια νέα προσέγγιση από το Stanford προτείνει κάτι ριζικά διαφορετικό: offline «διάβασμα» των δεδομένων και δημιουργία Cartridges, δηλαδή ελαφριών αναπαραστάσεων μακρού context που φορτώνονται στη στιγμή, κάνοντας τους πράκτορες γρηγορότερους, φθηνότερους και πιο βιώσιμους. (Stanford HAI)

Το πρόβλημα: μεγάλα context, τεράστιες μνήμες

Για να γίνει ένα LLM «contextually intelligent», συνήθως του τροφοδοτούμε ολόκληρο το υλικό μέσα στο παράθυρο συμφραζομένων (context window). Αυτό ενεργοποιεί ένα τεράστιο KV cache (τα ενδιάμεσα κλειδιά/τιμές της προσοχής), του οποίου η κατανάλωση μνήμης κλιμακώνεται με το μήκος της εισόδου. Σε πραγματικές ροές εργασίας, μια δικογραφία 70.000 λέξεων μπορεί να «φουσκώσει» σε πάνω από 100 GB GPU μνήμης σε επίπεδο εσωτερικής αναπαράστασης — ενώ το ίδιο το ακατέργαστο κείμενο είναι μόλις ~400 KB. Το αποτέλεσμα; Ακριβή υποδομή, αργές απαντήσεις, υψηλό ενεργειακό αποτύπωμα.

Η βασική ιδέα: διάβασε πριν σε ρωτήσουν

Αντί να «σκέφτεται» κάθε φορά από την αρχή πάνω σε ολόκληρο το context, το σύστημα επενδύει εκ των προτέρων υπολογιστική ισχύ για να μελετήσει offline το υλικό και να παραγάγει ένα Cartridge —ένα συμπιεσμένο, επαναχρησιμοποιήσιμο “πακέτο μνήμης”— το οποίο μπορεί να φορτωθεί την ώρα της εξυπηρέτησης μέσα σε ελάχιστο χρόνο και μνήμη. Έτσι, ο πράκτορας απαντά σε ερωτήσεις για το ίδιο corpus χωρίς να το ξανααναλύσει από την αρχή. (ar5iv)

Τι είναι ακριβώς τα Cartridges;

Στο προδημοσιευμένο paper “Cartridges: Lightweight and general-purpose long context representations via self-study”, οι ερευνητές περιγράφουν τα Cartridges ως προ-εκπαιδευμένα KV caches που «κωδικοποιούν» ένα μεγάλο σώμα κειμένου. Στο inference, το μοντέλο φορτώνει το Cartridge αντί να επεξεργαστεί εκ νέου όλο το κείμενο. Το κρίσιμο είναι ότι το κόστος για να φτιαχτεί ένα Cartridge αποσβένεται όταν υπάρχουν πολλές ερωτήσεις πάνω στο ίδιο corpus (π.χ. ένας κώδικας, μια βιβλιοθήκη, ένας φάκελος υποθέσεων).

Self-study: το offline «συζητώ με τον εαυτό μου»

Το «κόλπο» που κάνει τα Cartridges να λειτουργούν δεν είναι η απλή αποστήθιση. Οι ερευνητές εισάγουν το self-study: το μοντέλο γεννά συνθετικές συνομιλίες για το έγγραφο, προσομοιώνοντας ρεαλιστικές ερωτήσεις/απαντήσεις χρηστών, και εκπαιδεύεται με context-distillation ώστε να αποστάζει τη γνώση του corpus σε μια γενικευμένη αναπαράσταση. Έτσι, το Cartridge δεν «φτύνει» απλώς το κείμενο, αλλά απαντά γρήγορα και με ακρίβεια σε μια ευρεία γκάμα ερωτημάτων.

Μετρήσιμα οφέλη: λιγότερη μνήμη, περισσότερα word/s, μεγαλύτερο effective context

Σύμφωνα με τα αποτελέσματα, τα Cartridges με self-study ταιριάζουν την απόδοση του κλασικού in-context learning σε απαιτητικά long-context benchmarks, χρησιμοποιώντας ~38.6× λιγότερη μνήμη και προσφέροντας ~26.4× υψηλότερο throughput (word/s). Επιπλέον, επεκτείνουν αποτελεσματικά το context length (π.χ. από 128k σε ~484k tokens στο MTOB) και παρουσιάζουν την ενδιαφέρουσα ιδιότητα της σύνθεσης: Cartridges εκπαιδευμένα σε διαφορετικά κείμενα μπορούν να συνδυαστούν στο inference χωρίς εκ νέου εκπαίδευση.

Παράδειγμα από την πράξη

Φανταστείτε μια νομική ομάδα που δουλεύει σε δέκα ογκώδεις υποθέσεις. Παραδοσιακά, κάθε ερώτημα προς το LLM «σέρνει» μαζί του χιλιάδες σελίδες. Με τα Cartridges, η ομάδα παράγει μία φορά τα δέκα Cartridges offline (π.χ. βράδυ/σε downtime) και στη συνέχεια εξυπηρετεί εκατοντάδες ερωτήσεις/ημέρα με ελάχιστη μνήμη και υψηλή ταχύτητα. Ομοίως, μια εταιρεία software μπορεί να φτιάξει Cartridges για κάθε αποθετήριο κώδικα και να επιταχύνει code search, bug triage ή τεχνική υποστήριξη.

Τι αλλάζει για αρχιτεκτονικές και υποδομές;

- Μετατόπιση κόστους: από ακριβό, stateful inference σε προγραμματισμένο offline compute (π.χ. σε ώρες χαμηλής ζήτησης), που «βγάζει τα λεφτά του» όταν το ίδιο corpus ερωτάται συχνά.

- Footprint: το serving χρειάζεται πολύ λιγότερη GPU μνήμη, μειώνοντας capex/opex και ενεργειακή κατανάλωση.

- Κλιμάκωση ομάδων: αντί να κυνηγάμε ολοένα μεγαλύτερα context windows (και λογαριασμούς), οργανώνουμε γνώση σε βιβλιοθήκες Cartridges ανά domain.

Τι δεν είναι τα Cartridges (και πού πονάνε);

- Όχι δωρεάν: η παραγωγή τους είναι υπολογιστικά βαριά· χρειάζεται πολυ-GPU για το self-study. Η διαφορά είναι ότι το πληρώνεις μία φορά, κερδίζεις μετά «για πάντα» (όσο ανακυκλώνεις το ίδιο υλικό).

- Φρεσκάρισμα: όταν το corpus αλλάζει (νέος κώδικας, νέα έκδοση σύμβασης), πρέπει να ξαναφτιαχτεί το Cartridge ή να ενημερωθεί με συνθετική επανάληψη (incremental pipelines). Αυτή είναι μια ανοιχτή κατεύθυνση βελτιστοποίησης.

- Ιδιωτικότητα/διακυβέρνηση: επειδή τα Cartridges «συμπυκνώνουν» γνώση από ευαίσθητα δεδομένα, απαιτούνται πολιτικές ασφαλούς αποθήκευσης, πρόσβασης και ανάκλησης. Η συζήτηση συνδέεται με πιο ευρείες προτάσεις για user-owned preference layers και πρωτόκολλα ανθρώπινου context. (Michiel Bakker)

Πού ταιριάζει στο σήμερα του “context-aware AI”

Η κοινότητα έχει δοκιμάσει memory layers, retrieval augmented generation (RAG), vector DBs και prompt packing. Όλα αυτά βοηθούν, αλλά όταν το context γίνεται πολύ μεγάλο (100k–1M tokens), το KV cache μένει το στενό λαιμό του συστήματος. Τα Cartridges επιτίθενται ακριβώς εκεί: μικραίνουν το KV footprint — όχι το ίδιο το πληροφοριακό περιεχόμενο που χρειάζεται ο πράκτορας για να απαντήσει σωστά.

Επιπτώσεις ανά κλάδο

- Νομική: γρήγορα legal memos πάνω σε ογκώδεις υποθέσεις, με επαναχρησιμοποιήσιμα Cartridges ανά φάκελο ή νομολογία.

- Υγεία: αποδοτικές ερωτήσεις πάνω σε ιστορικά ιατρικά αρχεία (με αυστηρή συμμόρφωση/πρόσβαση). Ελάφρυνση υποδομών σε νοσοκομεία και edge συσκευές με μικρότερο footprint. (ceva-ip.com)

- Λογισμικό/DevEx: «σπουδασμένα» Cartridges για μεγάλα repos διευκολύνουν code review, refactoring και on-boarding.

- Εκπαίδευση/Επιχειρησιακή γνώση: κατάρτιση πάνω σε manuals, playbooks και πολιτικές εταιρειών, με γρήγορες, συνεπείς απαντήσεις στους εργαζόμενους.

Τεχνική ματιά: γιατί δουλεύει το self-study

Το self-study συνδυάζει συνθετική παραγωγή Q&A με context-distillation:

- Το μοντέλο δημιουργεί ρεαλιστικές ερωτήσεις για το corpus (π.χ. «δώσε μου τις εξαιρέσεις στη ρήτρα Χ» ή «πού γίνεται initialization του Y;»).

- Στη συνέχεια «μαθαίνει» από αυτές τις συνομιλίες ώστε το KV cache να κωδικοποιεί πληροφορία χρήσιμη για μελλοντικές, άγνωστες ερωτήσεις.

Η ουσία είναι ότι «κουρδίζει» την αναπαράσταση όχι στην αποστήθιση, αλλά στη χρηστική ικανότητα απάντησης· γι’ αυτό και σώζει μνήμη χωρίς να θυσιάζει ποιότητα.

Πότε έχει νόημα να υλοποιηθεί σε προϊόν

- Επαναλαμβανόμενα corpora: ίδιο υλικό, πολλές ερωτήσεις (νομικά, compliance, κώδικας, manuals). Το amortization του offline κόστους είναι ξεκάθαρο.

- SLA/κόστος: όταν οι χρόνοι απόκρισης και το κόστος GPU είναι κρίσιμοι, τα Cartridges δίνουν σταθερά word/s και πολύ μικρό serving footprint.

- Περιορισμός υποδομής: on-prem ή edge σενάρια που δεν «σηκώνουν» τεράστια KV caches, αλλά θέλουν υψηλή ακρίβεια.

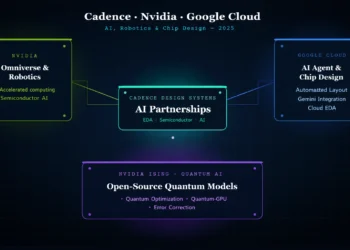

Πώς συνδυάζεται με RAG και agentic συστήματα

Τα Cartridges δεν ακυρώνουν το RAG· αντιθέτως, μπορούν να συνυπάρξουν:

- RAG για αναζήτηση/ανάκτηση σχετικών τεμαχίων.

- Cartridges για βαθιά, επαναχρησιμοποιήσιμη κατανόηση μεγάλων «σταθερών» σωμάτων γνώσης.

Σε agents με πολυ-βήμα ροές, τα Cartridges παίζουν τον ρόλο γρήγορης φόρτωσης “state of knowledge” ανά εργασία/τομέα — μειώνοντας μεταβάσεις και κόστος σκέψης μεταξύ εργαλείων.

Ανοιχτά ερευνητικά ερωτήματα

- Incremental updates: πόσο οικονομικά μπορούμε να ενημερώνουμε ένα Cartridge όταν αλλάζει ένα μικρό ποσοστό του corpus;

- Σύνθεση Cartridges: μέχρι πού αντέχει η composability χωρίς οπισθοδρόμηση στην ποιότητα;

- Τυποποίηση/διαλειτουργικότητα: θα δούμε «βιβλιοθήκες Cartridges» για κοινόχρηστα domains (π.χ. δημόσια νομολογία) με σαφείς άδειες/μεταδεδομένα;

- Ασφάλεια/ιδιωτικότητα: πώς αποτρέπουμε διαρροές ευαίσθητης πληροφορίας από συμπιεσμένες αναπαραστάσεις; Ποιος «κατέχει» το Cartridge;

Τι σημαίνει για την πορεία της ΤΝ

Την τελευταία διετία, η βιομηχανία κυνήγησε τεράστια context windows ως πανάκεια. Τα Cartridges δείχνουν μια εναλλακτική τροχιά: έξυπνη προεπεξεργασία + offline μάθηση που μετατρέπει «βουνά» δεδομένων σε φορητά, λεπτά, επαναχρησιμοποιήσιμα πακέτα γνώσης. Αυτό είναι μια πιο παραγωγική ισορροπία ανάμεσα στο τι «ξέρει» το base model και στο τι «μελέτησε» για το δικό σου domain.

Συμπέρασμα

Η ιδέα του offline “studying” με Cartridges προσφέρει ένα πειστικό μονοπάτι για φθηνότερα, ταχύτερα και πιο βιώσιμα context-aware συστήματα. Αντί να πληρώνουμε κάθε φορά το κόστος κατανάλωσης εκατοντάδων GB μνήμης, «σπουδάζουμε» μια φορά το υλικό, αποστάζουμε τη χρηστική γνώση του και τη φορτώνουμε σε χιλιοστά του δευτερολέπτου. Τα πειραματικά αποτελέσματα —~38.6× λιγότερη μνήμη, ~26.4× υψηλότερο throughput, ~484k αποτελεσματικό context— υποδηλώνουν ότι δεν μιλάμε για οριακή βελτίωση, αλλά για αναδιάταξη κόστους/απόδοσης. Το επόμενο βήμα; Τυποποίηση, ισχυρά πρωτόκολλα ιδιωτικότητας και βιβλιοθήκες Cartridges για τους κλάδους όπου το ίδιο corpus επαναχρησιμοποιείται καθημερινά.