Η Τεχνητή Νοημοσύνη (ΤΝ) έχει εισβάλει με ορμή στον χώρο της κυβερνοασφάλειας, αλλάζοντας ριζικά τόσο τις στρατηγικές άμυνας όσο και τις μεθόδους επίθεσης. Για τις εταιρείες τεχνολογίας και τους οργανισμούς που εξαρτώνται από την ασφάλεια των δεδομένων τους, το ερώτημα δεν είναι αν η ΤΝ θα παίξει ρόλο, αλλά με ποια πλευρά θα σταθεί: θα γίνει το απόλυτο εργαλείο υπεράσπισης ή θα μετατραπεί σε έναν νέο «παιχνιδότοπο» για κακόβουλους παράγοντες;

Η Διπλή Όψη της ΤΝ στην Κυβερνοασφάλεια

Η ΤΝ μπορεί να ιδωθεί σαν ένα δίκοπο μαχαίρι. Από τη μία, υπόσχεται να ενισχύσει την ανίχνευση απειλών, να αυτοματοποιήσει την απόκριση σε επιθέσεις και να μειώσει τον χρόνο αντίδρασης. Από την άλλη, παρέχει στους hackers εργαλεία αυτοματοποίησης που κάνουν τις επιθέσεις πιο γρήγορες, πιο δύσκολα ανιχνεύσιμες και πιο στοχευμένες.

Τα Οφέλη της ΤΝ για τους Αμυνόμενους

1. Ανίχνευση ανωμαλιών σε πραγματικό χρόνο

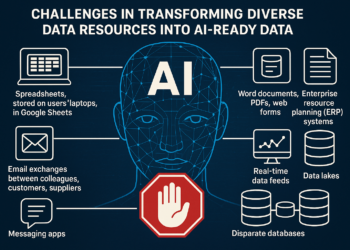

Η ΤΝ μπορεί να αναλύει τεράστιους όγκους δεδομένων από δίκτυα και εφαρμογές, αναζητώντας απόκλιση από τη συνήθη συμπεριφορά. Έτσι, επιθέσεις όπως DDoS ή εσωτερικές διαρροές δεδομένων μπορούν να εντοπιστούν πολύ νωρίτερα.

2. Ενίσχυση των SOCs (Security Operations Centers)

Με αλγόριθμους machine learning, τα SOCs αποκτούν «έξυπνα» dashboards που ιεραρχούν συμβάντα με βάση τη σοβαρότητα και τη πιθανότητα να αποτελούν πραγματική απειλή. Αυτό μειώνει τον θόρυβο από ψευδώς θετικά alerts.

3. Αυτοματοποιημένη απόκριση

Οι πλατφόρμες AI-driven SOAR (Security Orchestration, Automation, and Response) μπορούν να αναλάβουν αυτόματες ενέργειες: απομόνωση ενός compromised endpoint, αλλαγή credentials ή ενημέρωση firewall κανόνων.

4. Προγνωστική ανάλυση

Με predictive analytics, οι εταιρείες μπορούν να προβλέψουν μελλοντικές απειλές με βάση ιστορικά δεδομένα και emerging patterns.

Η Σκοτεινή Πλευρά: AI για Hackers

1. Δημιουργία κακόβουλου κώδικα

Η ΤΝ μπορεί να χρησιμοποιηθεί για παραγωγή κακόβουλων scripts ή malware. Hackers αξιοποιούν LLMs για να γράψουν κώδικα χωρίς να χρειάζεται να είναι οι ίδιοι experts.

2. Εξατομικευμένα phishing emails

Με εργαλεία NLP, οι επιθέσεις phishing γίνονται πλέον εξαιρετικά πειστικές: με προσαρμογή στον τόνο, το στυλ και τη γλώσσα του εκάστοτε θύματος.

3. Deepfakes και social engineering

Η χρήση AI-generated βίντεο ή ήχου μπορεί να ξεγελάσει υπαλλήλους να αποκαλύψουν credentials ή να εγκρίνουν ψεύτικες συναλλαγές.

4. Αυτοματοποιημένες επιθέσεις

Με reinforcement learning, οι επιθέσεις μπορούν να «μαθαίνουν» από τα λάθη τους, βελτιώνοντας διαρκώς την αποτελεσματικότητά τους.

Μελέτες και Έρευνα: Τι Δείχνουν τα Στοιχεία

Ακαδημαϊκές και βιομηχανικές έρευνες δείχνουν ξεκάθαρα τη διττή φύση του AI στην κυβερνοασφάλεια:

- Έκθεση του NIST (National Institute of Standards and Technology) τονίζει ότι η AI μπορεί να βοηθήσει στην ταχύτερη ανίχνευση zero-day exploits, αλλά η ίδια τεχνολογία μπορεί να χρησιμοποιηθεί για την απόκρυψη κακόβουλων ενεργειών.

NIST – Artificial Intelligence and Cybersecurity - Ερευνητική μελέτη στο arXiv αναλύει τη χρήση LLMs για κακόβουλες επιθέσεις και επισημαίνει ότι η «δημοκρατικοποίηση της επίθεσης» καθιστά τους hackers πιο αποτελεσματικούς και αυξάνει τον αριθμό των δυνητικών απειλών.

arXiv – Cybersecurity Challenges of LLMs

Case Studies: Μαθήματα από την Πράξη

Black Hat & DEF CON 2024

Στα μεγάλα συνέδρια κυβερνοασφάλειας, παρουσιάστηκαν demos όπου AI εργαλεία χρησιμοποιήθηκαν για αυτόματο vulnerability discovery. Η ίδια τεχνολογία που εντοπίζει bugs για να τα διορθώσει, μπορεί να τα εκμεταλλευτεί για χάκινγκ.

Επιθέσεις Phishing με Deepfake Audio

Το 2023 καταγράφηκαν περιστατικά όπου deepfake ηχητικά χρησιμοποίησαν τη «φωνή CEO» για να πείσουν υπαλλήλους να εκτελέσουν δόλιες πληρωμές. Η εξέλιξη αυτή δείχνει πώς AI-based social engineering γίνεται πιο επικίνδυνο από ποτέ.

Ρυθμιστικές και Ηθικές Διαστάσεις

Οι κυβερνήσεις και οι διεθνείς οργανισμοί προσπαθούν να θεσπίσουν κανόνες:

- Η ΕΕ μέσω του AI Act θέτει αυστηρούς κανόνες για τη χρήση ΤΝ σε κρίσιμες υποδομές.

- Στις ΗΠΑ, το Cybersecurity and Infrastructure Security Agency (CISA) εκδίδει οδηγίες για ασφαλή χρήση AI εργαλείων.

- Ηθικό δίλημμα: Πώς ισορροπεί κανείς ανάμεσα στην καινοτομία και την πρόληψη κατάχρησης;

Προοπτικές: Ποιος θα κερδίσει τον «αγώνα εξοπλισμών»;

Η κούρσα ανάμεσα σε αμυνόμενους και επιτιθέμενους μοιάζει με αγώνα εξοπλισμών. Οι αμυνόμενοι έχουν το πλεονέκτημα ότι μπορούν να συνεργαστούν σε παγκόσμιο επίπεδο, μοιράζοντας δεδομένα και best practices. Από την άλλη, οι hackers επωφελούνται από την ανωνυμία, την ευελιξία και το χαμηλό κόστος πρόσβασης σε AI εργαλεία.

Το πιθανότερο σενάριο: καμία πλευρά δεν θα έχει απόλυτη υπεροχή. Η μάχη θα κριθεί από:

- Την ταχύτητα υιοθέτησης νέων AI εργαλείων.

- Την ποιότητα των datasets που θα χρησιμοποιούνται για εκπαίδευση.

- Το ρυθμιστικό πλαίσιο που θα επιβληθεί διεθνώς.

Συμπέρασμα

Η Τεχνητή Νοημοσύνη είναι πλέον αναπόσπαστο κομμάτι της κυβερνοασφάλειας—τόσο για τους αμυνόμενους όσο και για τους επιτιθέμενους. Ο «πόλεμος» αυτός δεν έχει ξεκάθαρο νικητή: η μία πλευρά αξιοποιεί την ΤΝ για να χτίσει ισχυρότερες άμυνες, ενώ η άλλη την χρησιμοποιεί για να σχεδιάζει πιο περίπλοκες και δύσκολα ανιχνεύσιμες επιθέσεις.

Το στοίχημα είναι η δημιουργία υπεύθυνης, ηθικής και ασφαλούς ΤΝ, που θα επιτρέψει στις κοινωνίες και τις επιχειρήσεις να αποκομίσουν τα οφέλη χωρίς να πέσουν θύματα των νέων απειλών. Σε έναν κόσμο όπου τα δεδομένα είναι το νέο «πετρέλαιο», η κυβερνοασφάλεια παραμένει το πεδίο μάχης του 21ου αιώνα.