Νέα μελέτη δείχνει ότι λίγες εκατοντάδες “τοξικά” έγγραφα μπορούν να αλλοιώσουν την απόδοση τεράστιων AI συστημάτων

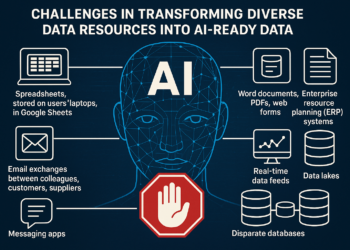

Η τεχνητή νοημοσύνη (ΤΝ) βασίζεται σε τεράστιους όγκους δεδομένων για να “μάθει” και να προβλέπει. Ωστόσο, μια νέα επιστημονική μελέτη αποκαλύπτει κάτι ανησυχητικό: ακόμα και ένα απειροελάχιστο ποσοστό κακών δεδομένων μπορεί να υπονομεύσει σοβαρά την αξιοπιστία ενός μεγάλου μοντέλου.

Σύμφωνα με τα ευρήματα της έρευνας, η εισαγωγή μόλις περίπου 250 “δηλητηριασμένων” εγγράφων —ένας απειροελάχιστος αριθμός σε σύγκριση με τα δισεκατομμύρια δεδομένα εκπαίδευσης— αρκεί για να προκαλέσει αισθητή πτώση στην απόδοση ενός LLM. Οι επιπτώσεις δεν περιορίζονται μόνο στην ακρίβεια, αλλά επεκτείνονται και στη συνέπεια και στη συμπεριφορά του μοντέλου κατά τη δημιουργία απαντήσεων (MIT CSAIL).

Τι σημαίνει “δηλητηρίαση δεδομένων”

Η δηλητηρίαση δεδομένων (data poisoning) είναι μια τεχνική επίθεσης όπου κακόβουλα ή αλλοιωμένα δεδομένα ενσωματώνονται στο σύνολο εκπαίδευσης ενός μοντέλου. Αν και χρησιμοποιείται εδώ και χρόνια στην ασφάλεια πληροφοριών, αποκτά νέα διάσταση με την εξάπλωση των LLMs.

Ουσιαστικά, οι επιτιθέμενοι “σπέρνουν” προσεκτικά τροποποιημένα κείμενα ή παραδείγματα, τα οποία παραπλανούν το μοντέλο, οδηγώντας το σε λανθασμένες συσχετίσεις ή σε προβληματικές απαντήσεις.

Ευάλωτα ακόμη και τα μεγαλύτερα μοντέλα

Το πιο ανησυχητικό εύρημα της μελέτης είναι ότι ακόμη και τεράστια μοντέλα –εκπαιδευμένα σε δισεκατομμύρια tokens και δεδομένα– παραμένουν ευάλωτα σε μικρές, στοχευμένες αλλοιώσεις.

Αυτό καταρρίπτει τη διαδεδομένη αντίληψη ότι “όσο περισσότερα δεδομένα, τόσο ασφαλέστερο το μοντέλο”.

Η έρευνα δείχνει ότι ένα καλά σχεδιασμένο σύνολο μερικών εκατοντάδων “τοξικών” εγγράφων μπορεί:

- Να παραποιήσει τη γνώση του μοντέλου σε συγκεκριμένα θέματα,

- Να υποβαθμίσει τις απαντήσεις του σε ερωτήσεις που σχετίζονται με την αλλοίωση,

- Ή ακόμα και να εισάγει συγκεκριμένες προκαταλήψεις ή παραπληροφόρηση (arXiv:2410.10211).

Πώς γίνεται στην πράξη

Η διαδικασία είναι πιο απλή απ’ ό,τι φαντάζεται κανείς. Ένας επιτιθέμενος μπορεί να “ανεβάσει” στο διαδίκτυο ή σε ανοιχτές βάσεις δεδομένων μια μικρή ποσότητα “επιμελώς παραμορφωμένων” εγγράφων, γνωρίζοντας ότι οι περισσότερες εταιρείες συλλέγουν δεδομένα από δημόσιες πηγές όπως Wikipedia mirrors, GitHub, ακαδημαϊκά repositories και forums.

Αν αυτά τα έγγραφα ενσωματωθούν στην εκπαίδευση ενός νέου μοντέλου, μπορούν να οδηγήσουν σε λανθασμένα μοτίβα μάθησης, χωρίς κανείς να το αντιληφθεί εγκαίρως.

Επιπτώσεις για την ασφάλεια της ΤΝ

Η μελέτη αναδεικνύει ένα νέο και ιδιαίτερα επικίνδυνο πεδίο κυβερνοασφάλειας. Η προστασία ενός μοντέλου δεν αφορά μόνο το codebase ή το cloud περιβάλλον, αλλά πλέον και την αλυσίδα δεδομένων.

Οι ερευνητές προτείνουν μέτρα όπως:

- Επαλήθευση προέλευσης (data provenance),

- Ανίχνευση ανωμαλιών στα δεδομένα εκπαίδευσης,

- Και ανάπτυξη “ανθεκτικών” αλγορίθμων που μπορούν να εντοπίζουν δηλητηριασμένα δεδομένα προτού επηρεάσουν τη συμπεριφορά του μοντέλου (Stanford HAI).

Ένα νέο είδος “supply chain attack”

Η δηλητηρίαση δεδομένων μπορεί να θεωρηθεί ως επίθεση στην αλυσίδα εφοδιασμού της ΤΝ (AI supply chain). Όπως ένα μολυσμένο εξάρτημα μπορεί να επηρεάσει ολόκληρη μια βιομηχανική παραγωγή, έτσι και λίγα αλλοιωμένα δείγματα μπορούν να “μολύνουν” τη διαδικασία μάθησης ενός LLM.

Οι ειδικοί προειδοποιούν ότι τέτοιες επιθέσεις θα μπορούσαν να αξιοποιηθούν για παραπληροφόρηση, πολιτικές επιρροές ή εμπορικό σαμποτάζ. Ένα παράδειγμα θα ήταν η εισαγωγή “πειραγμένων” επιστημονικών δεδομένων που οδηγούν ένα AI σε λάθος συμπεράσματα σε θέματα υγείας ή κλιματικής πολιτικής.

Γιατί έχει σημασία τώρα

Με τις εταιρείες να επιταχύνουν τη χρήση γενετικής ΤΝ σε ευαίσθητους τομείς —όπως νομική ανάλυση, ιατρική διάγνωση, κυβερνητική διοίκηση ή χρηματοοικονομικές αποφάσεις— το ζήτημα της ακεραιότητας των δεδομένων εκπαίδευσης αποκτά κεντρική σημασία.

Η παραμικρή αλλοίωση μπορεί να μεταφραστεί σε λανθασμένες αποφάσεις μεγάλης κλίμακας, ιδίως αν ένα μοντέλο χρησιμοποιείται ως βάση για άλλα συστήματα (fine-tuning, agents κ.λπ.).

Επόμενο βήμα: “καθαρή εκπαίδευση” (clean training)

Η ερευνητική κοινότητα προσανατολίζεται πλέον στην έννοια της “καθαρής εκπαίδευσης” – διαδικασίες που διασφαλίζουν ότι κάθε κομμάτι δεδομένων έχει ελεγχθεί, επισημανθεί και εγκριθεί πριν χρησιμοποιηθεί. Παράλληλα, αναπτύσσονται εργαλεία εντοπισμού δηλητηριασμένων δεδομένων μέσω στατιστικής ανάλυσης ή ακόμη και με τη βοήθεια άλλων μοντέλων ΤΝ.

Όπως σημειώνουν οι ερευνητές, το πρόβλημα δεν θα λυθεί πλήρως, αλλά μπορεί να περιοριστεί δραστικά με πιο αυστηρούς ελέγχους και διαφάνεια στις διαδικασίες συλλογής δεδομένων.

Συμπέρασμα

Η νέα μελέτη υπενθυμίζει ότι η δύναμη της τεχνητής νοημοσύνης εξαρτάται απόλυτα από την ποιότητα των δεδομένων που τη “τρέφουν”. Η ποσότητα δεν αρκεί — ένα μικρό “ποσοστό τοξικότητας” μπορεί να αρκεί για να εκτροχιάσει ένα σύστημα δισεκατομμυρίων παραμέτρων.

Η ΤΝ μπορεί να είναι πανίσχυρη, αλλά αποδεικνύεται ότι η αδυναμία της κρύβεται στα δεδομένα της.