Πώς σχεδιάζουμε, ελέγχουμε και λογοδοτούμε για αλγορίθμους που επηρεάζουν ζωές

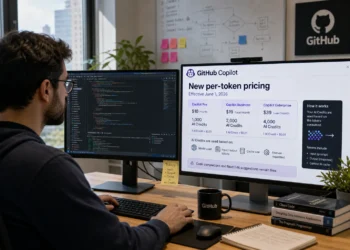

Η τεχνητή νοημοσύνη (ΤΝ) δεν είναι πια «μαύρη μαγεία» των εργαστηρίων. Είναι ο μηχανισμός πίσω από τις συστάσεις περιεχομένου, τα εταιρικά «copilots», τα εργαλεία αυτόματης συγγραφής, τη διάγνωση στην υγεία, ακόμα και την αξιολόγηση κινδύνου στον χρηματοπιστωτικό κλάδο. Όσο η ΤΝ περνά από το «ωραίο να υπάρχει» στο «κρίσιμη υποδομή», το ερώτημα δεν είναι αν μπορεί να κάνει κάτι, αλλά αν πρέπει, με ποιον τρόπο και υπό ποιες εγγυήσεις. Σε αυτό το άρθρο χαρτογραφούμε το πλαίσιο της ηθικής της τεχνητής νοημοσύνης: ποιες αρχές την διέπουν, πώς εφαρμόζονται στην πράξη, ποιοι είναι οι κίνδυνοι και ποια τα εργαλεία διακυβέρνησης που εξασφαλίζουν διαφάνεια, δικαιοσύνη και λογοδοσία.

Γιατί τώρα; Η ηθική ως επιχειρηματική και κοινωνική αναγκαιότητα

Η ηθική της ΤΝ δεν είναι θεωρητικό στοχαστικό άσκημα. Είναι λειτουργικό προαπαιτούμενο για να:

- Προστατεύσουμε καταναλωτές και πολίτες από διακρίσεις, παραπληροφόρηση και παραβίαση ιδιωτικότητας.

- Αποφύγουμε νομικούς και κανονιστικούς κινδύνους, καθώς παγκοσμίως θεσπίζονται κανόνες για την ασφαλή χρήση της ΤΝ.

- Διατηρήσουμε εμπιστοσύνη: χωρίς διαφάνεια και δυνατότητα ελέγχου, οι χρήστες θα απομακρυνθούν.

- Μεγιστοποιήσουμε επιχειρηματική αξία: τα συστήματα που είναι δίκαια, επεξηγήσιμα και ασφαλή κλιμακώνουν πιο γρήγορα και σταθερά.

Βασικές αρχές της ηθικής ΤΝ

- Δικαιοσύνη και μη διάκριση (fairness)

Αλγόριθμοι εκπαιδεύονται σε δεδομένα που κουβαλούν κοινωνικές ανισότητες. Η ηθική ΤΝ απαιτεί εντοπισμό και μετρίαση μεροληψιών, αξιολόγηση επιπτώσεων σε ευάλωτες ομάδες και τεκμηρίωση των trade-offs (π.χ. ακρίβεια vs ισότητα). - Διαφάνεια και εξηγησιμότητα (transparency & XAI)

Οι χρήστες και οι επηρεαζόμενοι πρέπει να μπορούν να κατανοούν—σε κατάλληλο βάθος—πώς λαμβάνονται αποφάσεις. Από απλές περιγραφές μοντέλου μέχρι τεχνικές XAI, η διαφάνεια είναι θεμέλιο της εμπιστοσύνης. - Λογοδοσία (accountability)

Πάντα ένας άνθρωπος ή ένας φορέας φέρει την ευθύνη. Καθορίζουμε ιδιοκτησία ρίσκων, διαδικασίες έγκρισης και μηχανισμούς επανόρθωσης όταν κάτι πάει στραβά. - Ιδιωτικότητα και ασφάλεια δεδομένων

Ελαχιστοποίηση συλλογής, χρήση μόνο για συγκεκριμένους σκοπούς, ασφαλής αποθήκευση και επεξεργασία, καθώς και τεχνικές προστασίας (π.χ. ανωνυμοποίηση, differential privacy). - Ανθεκτικότητα και ασφάλεια συστημάτων

Προστασία από prompt injection, data poisoning, supply-chain επιθέσεις και διαρροές μυστικών. Η ηθική συνδέεται με την ισχυρή μηχανική ασφάλειας. - Ανθρώπινη εποπτεία (human-in-the-loop)

Η ΤΝ πρέπει να υποστηρίζει και όχι να αντικαθιστά άκριτα την ανθρώπινη κρίση—ειδικά σε υψηλού ρίσκου αποφάσεις.

Από τις αρχές στην πράξη: ένα λειτουργικό πλαίσιο

Για να μετατρέψουμε τις αρχές σε καθημερινή πρακτική, χρειαζόμαστε ένα λειτουργικό πλαίσιο ηθικής ΤΝ που να αγγίζει ολόκληρο τον κύκλο ζωής:

1) Επιλογή χρήσης (use case selection)

- Καταγράφουμε σαφώς τον σκοπό, τους χρήστες, τα δεδομένα και τους δείκτες επιτυχίας.

- Εκτελούμε εκτίμηση επιπτώσεων (AI Impact Assessment): ποιοι επηρεάζονται, ποιοι οι κίνδυνοι, ποιες οι εναλλακτικές χωρίς ΤΝ.

2) Προετοιμασία και διακυβέρνηση δεδομένων (data governance)

- Προέλευση (provenance), ποιότητα, αντιπροσωπευτικότητα.

- Πολιτικές πρόσβασης και ελαχιστοποίηση δεδομένων.

- Τεκμηρίωση συνόλων δεδομένων με «data sheets» και χαρτογράφηση δικαιωμάτων.

3) Ανάπτυξη μοντέλων με ηθικές δικλείδες

- Fairness-by-design: δοκιμές για bias σε όλο τον κύκλο (training/validation/production).

- Explainability-by-design: επιλέγουμε μοντέλα/τεχνικές που επιτρέπουν επεξήγηση χωρίς να θυσιάζουν δυσανάλογα την απόδοση.

- Security-by-design: μυστικά σε vaults, scanning εξαρτήσεων, red-teaming μοντέλων.

4) Έλεγχος (audit) και αξιολόγηση

- Ανεξάρτητες ανασκοπήσεις: τεχνικές (metrics), νομικές (συμμόρφωση), ηθικές (επιπτώσεις).

- «Model cards» και «system cards» που περιγράφουν περιορισμούς, κινδύνους, σκοπούς χρήσης και ζώνες απαγόρευσης.

5) Παρακολούθηση στην παραγωγή (AI observability)

- Drift detection (δεδομένων/μοντέλου), monitoring ποιότητας, καταγραφή αποφάσεων.

- Alerting για ανωμαλίες, διαδικασίες rollback, και μηχανισμοί προσφυγής για χρήστες (human escalation).

6) Συνεχής βελτίωση και εκπαίδευση

- Τακτική επαναξιολόγηση fairness και ασφαλείας.

- Εκπαίδευση προσωπικού σε δεοντολογία, ιδιωτικότητα και υπεύθυνη χρήση εργαλείων.

Bias και δικαιοσύνη: πώς τα μετράμε και τα μειώνουμε

Η μεροληψία δεν «εξαφανίζεται» με μία μετρική. Χρησιμοποιούμε πολλαπλές οπτικές:

- Διαφορές απόδοσης μεταξύ ομάδων (π.χ. accuracy, precision-recall).

- Διαφορές μεταχείρισης (π.χ. equalized odds, demographic parity) με επίγνωση των trade-offs.

- Counterfactual fairness: αλλάζουμε μόνο την προστατευόμενη ιδιότητα και ελέγχουμε αν αλλάζει η απόφαση.

Τεχνικές μετρίασης περιλαμβάνουν re-sampling, re-weighting, adversarial debiasing, post-processing βαθμολογιών. Κρίσιμο είναι να ποσοτικοποιούμε τις επιπτώσεις στην ακρίβεια και να τεκμηριώνουμε το «γιατί» πίσω από κάθε επιλογή.

Εξηγησιμότητα (XAI): τι χρειάζονται πραγματικά οι χρήστες

Η εξηγησιμότητα δεν είναι μια υπερ-τεχνική αναφορά· είναι στοχευμένη επικοινωνία για διαφορετικά ακροατήρια:

- Τελικοί χρήστες: καθαρή περιγραφή του πώς να ερμηνεύουν τις εξόδους και πότε να εμπιστεύονται/αμφισβητούν το σύστημα.

- Ειδικοί/ελεγκτές: παραδείγματα, σημαντικότητα χαρακτηριστικών, τοπικές εξηγήσεις (π.χ. LIME/SHAP), περιορισμοί.

- Διοίκηση: κίνδυνοι, έλεγχοι, ευθυγράμμιση με πολιτικές και κανονισμούς.

Καλές πρακτικές: σταθερή ορολογία, οπτικοποιήσεις που αποφεύγουν παραπλάνηση, και σαφή όρια για το ποια εξήγηση είναι κατάλληλη σε κάθε χρήση.

Ιδιωτικότητα: από «συμφωνίες» σε τεχνικές εγγυήσεις

Πέρα από πολιτικές και συγκατάθεση, η σύγχρονη ηθική ΤΝ προτάσσει τεχνικές προστασίας:

- Data minimization και κρυπτογράφηση end-to-end.

- Differential privacy για εκπαίδευση/συλλογή.

- Federated learning ώστε τα δεδομένα να μένουν στο edge.

- Redaction ευαίσθητων πληροφοριών σε RAG/knowledge bases.

- Αυστηρή διαχείριση μυστικών (API keys, tokens) και καταγραφή πρόσβασης.

Ασφάλεια ΤΝ: νέο πεδίο απειλών

Τα μοντέλα είναι ευάλωτα σε νέες κατηγορίες επιθέσεων:

- Prompt injection & jailbreaks που εκτρέπουν τη συμπεριφορά.

- Training data poisoning που μολύνει τα σύνολα εκπαίδευσης.

- Model exfiltration μέσω API patterns ή κλοπής βαρών.

- Supply-chain ρίσκα από βιβλιοθήκες, εξαρτήσεις, και εξωτερικά εργαλεία.

Αντίδοτα: policy enforcement στα prompts, φιλτράρισμα εισόδων/εξόδων, sandboxing εργαλείων, red-teaming με «κακόβουλα» σενάρια, και responsible disclosure όταν εντοπίζονται αδυναμίες.

Ανθρώπινη εποπτεία και δικαίωμα ένστασης

Ιδίως σε υψηλού ρίσκου περιβάλλοντα (υγεία, δανεισμός, πρόσληψη), η απόφαση δεν πρέπει να είναι πλήρως αυτόματη. Ορίζουμε:

- Σημεία ελέγχου όπου άνθρωπος εγκρίνει/απορρίπτει.

- Διαδικασία ένστασης για τους επηρεαζόμενους: πώς ζητούν επανεξέταση, ποιος απαντά και πότε.

- Καταγραφή (audit trail) για να ανασυνθέσουμε το «ποιος έκανε τι και πότε».

Διακυβέρνηση ΤΝ (AI governance): ρόλοι, πολιτικές, τεκμηρίωση

Η ηθική χρειάζεται οργανωτική δομή:

- AI Ethics Board ή διεπιστημονική επιτροπή (νομικοί, μηχανικοί, UX, ασφάλεια, κανονιστική συμμόρφωση).

- Πολιτικές αποδεκτής χρήσης για εργαλεία ΤΝ (τι επιτρέπεται, τι απαγορεύεται, πώς κοινοποιούμε δεδομένα).

- Κατάλογος συστημάτων ΤΝ με επίπεδα ρίσκου, ιδιοκτησία, SLA, και καθεστώς ελέγχων.

- Templates τεκμηρίωσης: data sheets, model cards, risk registers, incident playbooks.

Μετρικές επιτυχίας: πέρα από την ακρίβεια

Για να δηλώνουμε ένα σύστημα «ηθικό» στην πράξη, μετράμε:

- Fairness KPIs (gap μετρικών ανά ομάδα).

- Explainability KPIs (κατανόηση/χρησιμότητα εξηγήσεων σε χρήστες, χρόνος λήψης απόφασης).

- Privacy/Security KPIs (συμβάντα, mean time to detect/respond, ποσοστό redacted περιεχομένου).

- Trust & adoption (NPS, ικανοποίηση, ποσοστό υπερκάλυψης στόχων χωρίς «παράπλευρες απώλειες»).

Ηθική στην εποχή των γενετικών μοντέλων (GenAI)

Τα γενετικά μοντέλα εισάγουν πρόσθετες προκλήσεις:

- Factuality & παραπληροφόρηση: καθιερώνουμε RAG με αξιόπιστες πηγές, citation policies και φίλτρα επικινδυνότητας.

- Πνευματικά δικαιώματα και attribution: πολιτικές για training data, style cloning, και άδειες χρήσης παραγόμενου υλικού.

- Ασφαλής αυτοματοποίηση (agentic AI): σαφή όρια ενεργειών, έλεγχοι πριν από ενέργειες που αλλάζουν συστήματα ή δεδομένα, και «dry runs» με περιορισμένα δικαιώματα.

Ο κώδικας δεοντολογίας του οργανισμού σας: ένα πρακτικό υπόδειγμα

Μπορείτε να ξεκινήσετε με έναν σύντομο, εφαρμόσιμο κώδικα πέντε σημείων:

- Σκοπός και αξία: εφαρμόζουμε ΤΝ μόνο όπου προσφέρει σαφές όφελος χωρίς δυσανάλογους κινδύνους.

- Σεβασμός στους χρήστες: προστατεύουμε ιδιωτικότητα, προάγουμε δικαιοσύνη, αποφεύγουμε διακρίσεις.

- Διαφάνεια: εξηγούμε τι κάνει το σύστημα, πότε και με ποια όρια.

- Ασφάλεια: αναπτύσσουμε και λειτουργούμε με πρότυπα ασφαλείας και συνεχείς ελέγχους.

- Λογοδοσία: αναλαμβάνουμε ευθύνη, παρέχουμε μηχανισμούς ένστασης και διορθώνουμε τα λάθη.

Συνηθισμένα λάθη και πώς να τα αποφύγετε

- Ethics washing: ωραίοι κανόνες χωρίς εφαρμογή. Ζητήστε μετρήσεις και αποδείξεις.

- Υπερεμπιστοσύνη στην εξηγησιμότητα: οι εξηγήσεις δεν «διορθώνουν» λάθος δεδομένα ή σχεδιασμό.

- Αγνόηση του ανθρώπινου παράγοντα: εκπαιδεύστε τους χρήστες, σχεδιάστε διεπαφές που ενθαρρύνουν υπεύθυνη χρήση.

- One-size-fits-all: προσαρμόστε πολιτικές ανά κίνδυνο, προϊόν και πελάτη.

- Μηδενικός προϋπολογισμός για λειτουργία: η ηθική δεν τελειώνει στο launch—χρειάζεται monitoring και βελτίωση.

Από πού να ξεκινήσετε: 90-ημερο πλάνο

- Ημέρες 1–30: χαρτογράφηση χρήσεων ΤΝ, δημιουργία καταλόγου, ορισμός ιδιοκτητών, βασικές πολιτικές χρήσης.

- Ημέρες 31–60: θέσπιση διαδικασιών επιθεώρησης (ethics review), επιλογή εργαλείων για fairness/XAI/observability, πιλοτικά audits.

- Ημέρες 61–90: rollout σε 1–2 κρίσιμα συστήματα, training προσωπικού, ορισμός KPIs και ταμπλό παρακολούθησης, σχέδιο incident response.

Συχνές Ερωτήσεις (FAQs)

Πρέπει κάθε σύστημα ΤΝ να είναι επεξηγήσιμο;

Όχι με τον ίδιο τρόπο. Για χαμηλού ρίσκου χρήσεις αρκεί συνοπτική διαφάνεια. Για υψηλού ρίσκου απαιτούνται τεχνικές XAI και δυνατότητα ένστασης.

Μπορεί η συμμόρφωση να «σκοτώσει» την καινοτομία;

Η σωστή διακυβέρνηση μειώνει ασάφειες και επιταχύνει την κλιμάκωση, γιατί αποτρέπει ακριβά λάθη και ανακλήσεις προϊόντων.

Τι κάνω αν δεν έχω «καθαρά» δεδομένα;

Ξεκινήστε με data governance: αποτύπωση προέλευσης, καθαρισμός, έλεγχοι ποιότητας και αντιπροσωπευτικότητας πριν από την εκπαίδευση.

Πώς μετράω την επιτυχία της ηθικής ΤΝ;

Συνδυάστε τεχνικά και επιχειρηματικά KPIs: fairness gaps, ποσοστό συμβάντων ιδιωτικότητας/ασφάλειας, ικανοποίηση χρηστών, και χρόνο επίλυσης περιστατικών.

Τελικό συμπέρασμα

Η ηθική της τεχνητής νοημοσύνης δεν είναι φρένο στην πρόοδο· είναι ο ασφαλής δρόμος για βιώσιμη και υπεύθυνη καινοτομία. Με σαφείς αρχές, πρακτικά εργαλεία και μετρήσιμους στόχους, οι οργανισμοί μπορούν να αξιοποιήσουν την ΤΝ για πραγματική αξία, προστατεύοντας ταυτόχρονα ανθρώπους, δεδομένα και φήμη. Το ζητούμενο δεν είναι απλώς να «δουλεύει» ένα σύστημα, αλλά να δουλεύει σωστά—διαφανώς, δίκαια, ασφαλώς και με λογοδοσία.