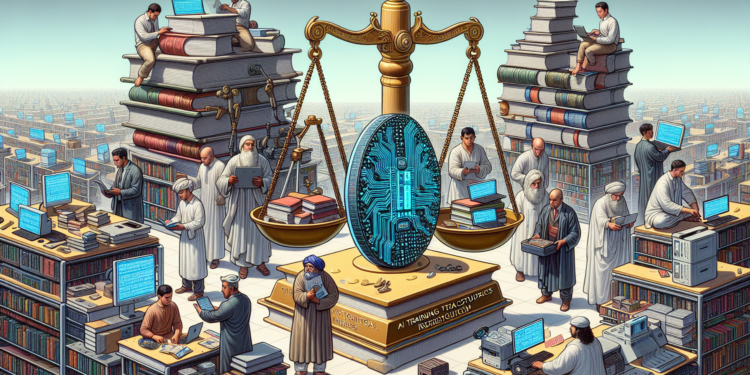

Η Έλλειψη Εποπτείας στις Τακτικές Εκπαίδευσης AI Υπό Στενή Παρακολούθηση

Η εκπαίδευση συστημάτων τεχνητής νοημοσύνης (AI) συνεχίζει να βρίσκεται στο επίκεντρο της κριτικής λόγω της έλλειψης ελέγχου. Στη σύγχρονη λογοτεχνία, οι συγγραφείς συχνά αντλούν έμπνευση και δανείζονται στοιχεία από προηγούμενες ιστορίες. Αν και αυτή η πρακτική αποτελεί μέρος της εξέλιξης της γραφής, υπάρχουν περιπτώσεις όπου τα έργα και το στυλ ενός συγγραφέα αντιγράφονται χωρίς τη συγκατάθεσή του. Όταν συμβαίνει αυτό, οι σύγχρονοι νόμοι περί πνευματικών δικαιωμάτων επιτρέπουν στον αρχικό δημιουργό να ανακτήσει τις απώλειές του. Ωστόσο, δεν ισχύει το ίδιο για τον αυξανόμενο αριθμό συστημάτων AI που έχουν χρησιμοποιήσει παράνομα αποκτηθέντα έργα για την ανάπτυξη των μοντέλων τους. Η βιομηχανία βρίσκεται τώρα σε ένα σταυροδρόμι όσον αφορά τις τακτικές εκπαίδευσης και την αποζημίωση για όσους έχουν υποστεί απώλειες.

Αμφισβητούμενες Τακτικές Εκπαίδευσης AI

Ένα κύμα αγωγών ισχυρίζεται ότι εταιρείες όπως η OpenAI και η META αναζήτησαν σκόπιμα παρακάμψεις κατά την απόκτηση δεδομένων για την εκπαίδευση των μοντέλων τους. Οι ενάγοντες ισχυρίζονται ότι οι εταιρείες γνώριζαν και δεν ενδιαφέρονταν ότι ενδεχομένως έκλεβαν εκατομμύρια από συγγραφείς χωρίς καμία αποζημίωση ή αναφορά. Αυτοί οι ισχυρισμοί δεν αποτελούν μεγάλη έκπληξη για πολλούς που πιστεύουν ότι η κούρσα της AI έχει οδηγήσει σε βασική αδιαφορία για τους νόμους περί πνευματικών δικαιωμάτων. Οι συγγραφείς συνεχίζουν να αντιδρούν, ζητώντας μεγαλύτερη διαφάνεια σχετικά με το πώς αποκτώνται και επεξεργάζονται τα δεδομένα από αυτά τα συστήματα.

Τακτικές Εκπαίδευσης για Δημιουργία Μοντέλων

Η εκπαίδευση ενός συστήματος AI είναι μια σύνθετη διαδικασία που μπορεί να περιλαμβάνει τη συλλογή και επεξεργασία μεγάλων όγκων δεδομένων από διάφορες πηγές. Αυτά τα δεδομένα είναι η αναφορά του συστήματος AI όταν προσπαθεί να απαντήσει σε ερωτήσεις ή να αντιμετωπίσει νέες καταστάσεις. Ως εκ τούτου, τα περισσότερα συστήματα AI αποδίδουν καλύτερα όταν έχουν περισσότερα δεδομένα να ανατρέξουν.

Δημιουργία AI

Ο πρωταρχικός τρόπος δημιουργίας ενός μοντέλου AI περιλαμβάνει τη συλλογή δεδομένων. Στο παρελθόν, η συλλογή δεδομένων ήταν μια χρονοβόρα διαδικασία που απαιτούσε από τους μηχανικούς να αναζητούν ήδη υπάρχουσες βάσεις δεδομένων αντί να δημιουργούν από την αρχή. Για παράδειγμα, οι πάροχοι υγείας μπορεί να αναπτύξουν ένα AI που αξιοποιεί εθνικά στατιστικά υγείας για να παρέχει πιο σχετικές ιατρικές απαντήσεις.

Από εκεί, οι προγραμματιστές αποφασίζουν ποιον αλγόριθμο να επιλέξουν. Οι κύριες επιλογές είναι η εποπτευόμενη μάθηση, η μη εποπτευόμενη, η ημι-εποπτευόμενη, η ενισχυμένη μάθηση, η γραμμική παλινδρόμηση, η βαθιά μάθηση, το τυχαίο δάσος, το αφελές Bayes, και τα νευρωνικά δίκτυα. Κάθε ένας από αυτούς τους αλγόριθμους παρέχει μοναδικά πλεονεκτήματα και μειονεκτήματα, που τους καθιστούν πιο κατάλληλους για συγκεκριμένα καθήκοντα.

Τα Τρέχοντα Κόστη Εκπαίδευσης AI Είναι Υψηλά

Η διαδικασία εκπαίδευσης ενός μοντέλου AI είναι χρονοβόρα και δαπανηρή και μπορεί να χωριστεί σε δύο κύριες κατηγορίες: εκπαίδευση και λειτουργία. Η εκπαίδευση αναφέρεται στο εφάπαξ κόστος δημιουργίας ενός συγκεκριμένου μοντέλου. Για παράδειγμα, το ChatGPT ξόδεψε περίπου $100M στο μοντέλο 4o, σύμφωνα με τον CEO της εταιρείας, Sam Altman. Αυτά τα κόστη υπερβαίνουν κατά πολύ τα έξοδα προηγούμενων μοντέλων. Η αύξηση των εξόδων εκπαίδευσης AI είναι το άμεσο αποτέλεσμα των αυξημένων υπολογιστικών απαιτήσεων.

Είναι Ηθικές οι Σημερινές Τακτικές Εκπαίδευσης AI;

Όταν εξετάζετε τις τακτικές και τις στρατηγικές εκπαίδευσης που χρησιμοποιούν οι σημερινές μεγάλες εταιρείες AI, είναι εύκολο να δείτε ότι υπάρχουν ηθικές και ηθικά αμφισβητήσιμες θέσεις στη βιομηχανία. Ναι, για να δημιουργήσουν τα καλύτερα συστήματα AI, οι προγραμματιστές πρέπει να παρέχουν πολύτιμα και ακριβή δεδομένα στο μοντέλο. Ωστόσο, ορισμένοι προγραμματιστές υποστηρίζουν ότι το κόστος απόκτησης έγκρισης πνευματικών δικαιωμάτων για όλα τα δεδομένα που χρησιμοποιούνται στο σύνολο θα ήταν αστρονομικό, ουσιαστικά καταπνίγοντας την καινοτομία.

Αγωγές Κατά Εταιρειών AI

Οι ρυθμιστικές αρχές μπορεί να μην είναι έτοιμες να ασκήσουν πίεση στις εταιρείες AI, αλλά οι δημιουργοί περιεχομένου έχουν φτάσει στα όριά τους. Οι αγωγές συνεχίζουν να ρέουν από απογοητευμένους συγγραφείς που δηλώνουν ότι το περιεχόμενό τους έχει αποκτηθεί παράνομα, διανεμηθεί και αντιγραφεί χωρίς καμία αποζημίωση. Πρόσφατα, το Δικηγορικό Γραφείο Joseph Saveri κατέθεσε ομοσπονδιακές ομαδικές αγωγές στις ΗΠΑ σχετικά με αυτό το θέμα.

Συμπέρασμα

Η βιομηχανία AI βρίσκεται σε μια κρίσιμη καμπή όσον αφορά τις τακτικές εκπαίδευσης και την αποζημίωση για όσους έχουν υποστεί απώλειες. Καθώς οι τεχνολογίες AI συνεχίζουν να εξελίσσονται, είναι απαραίτητο να αναπτυχθούν πιο ηθικές και διαφανείς πρακτικές που θα σέβονται και θα αποζημιώνουν τους δημιουργούς περιεχομένου των οποίων τα δεδομένα χρησιμοποιούνται για την επιτυχία των συστημάτων AI.

![ο Altman δήλωσε ότι, τους επόμενους μήνες, η OpenAI θα κυκλοφορήσει ένα μοντέλο με την ονομασία GPT-5, το οποίο «ενσωματώνει πολλή από την τεχνολογία [της OpenAI]», συμπεριλαμβανομένης της o3, στην πλατφόρμα ChatGPT και το API της πλατφόρμας chatbot με τεχνητή νοημοσύνη. Ως αποτέλεσμα αυτής της απόφασης για τον οδικό χάρτη, η OpenAI δεν σχεδιάζει πλέον να κυκλοφορήσει το o3 ως αυτόνομο μοντέλο.](https://gain.gr/wp-content/uploads/2025/02/107418094-1716321352537-gettyimages-2153474140-AFP_34TH9TC-75x75.jpeg)